如何在AI项目中保护个人隐私数据

在人工智能(AI)项目中使用个人隐私数据已变得越来越普遍,但也带来了一系列风险。了解如何在AI项目中保护个人隐私数据至关重要,包括数据收集、使用和存储等各个环节。本文将深入探讨如何在AI项目中保护个人隐私数据,并提供可操作的建议。

AI项目中个人隐私数据保护的重要性

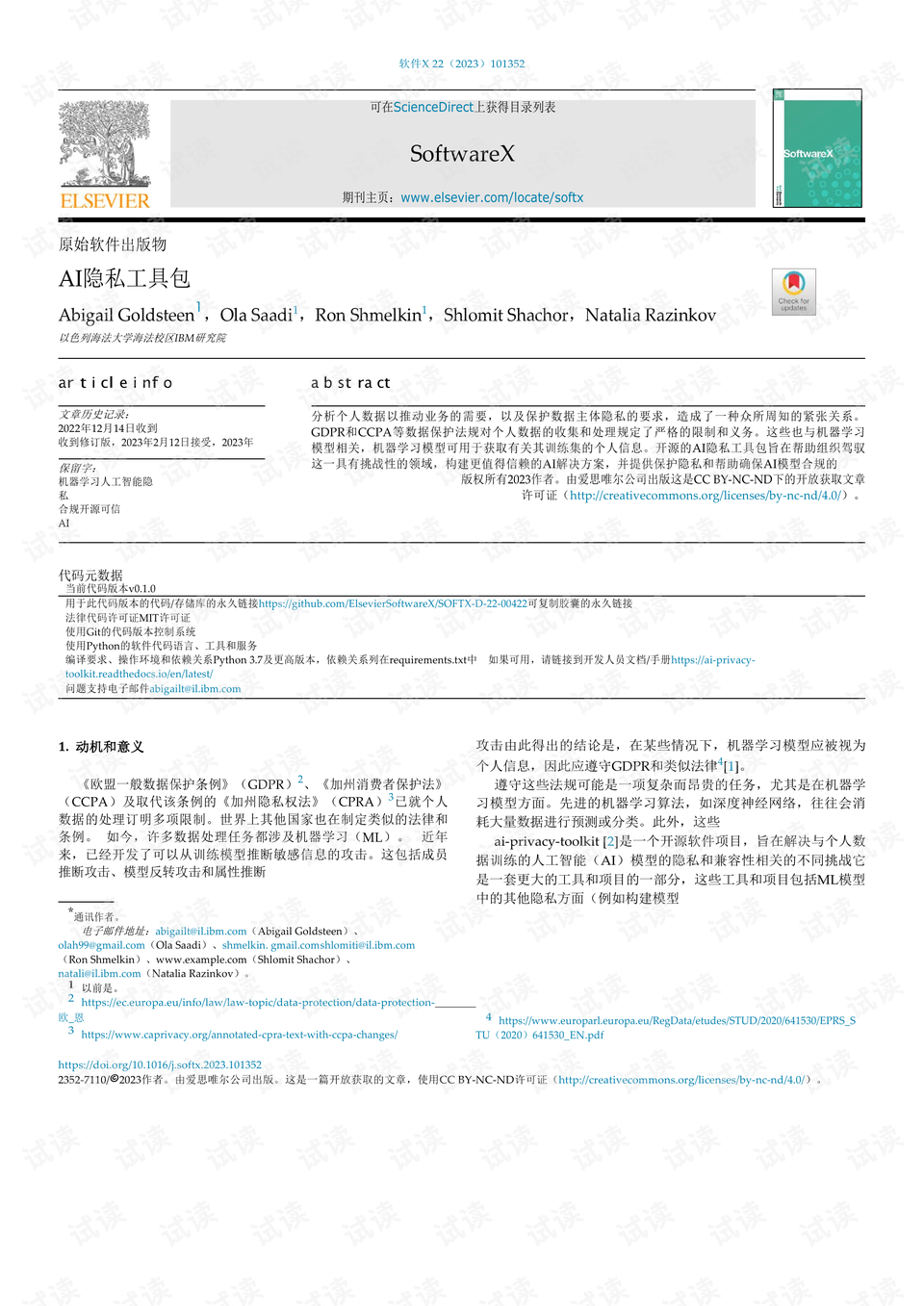

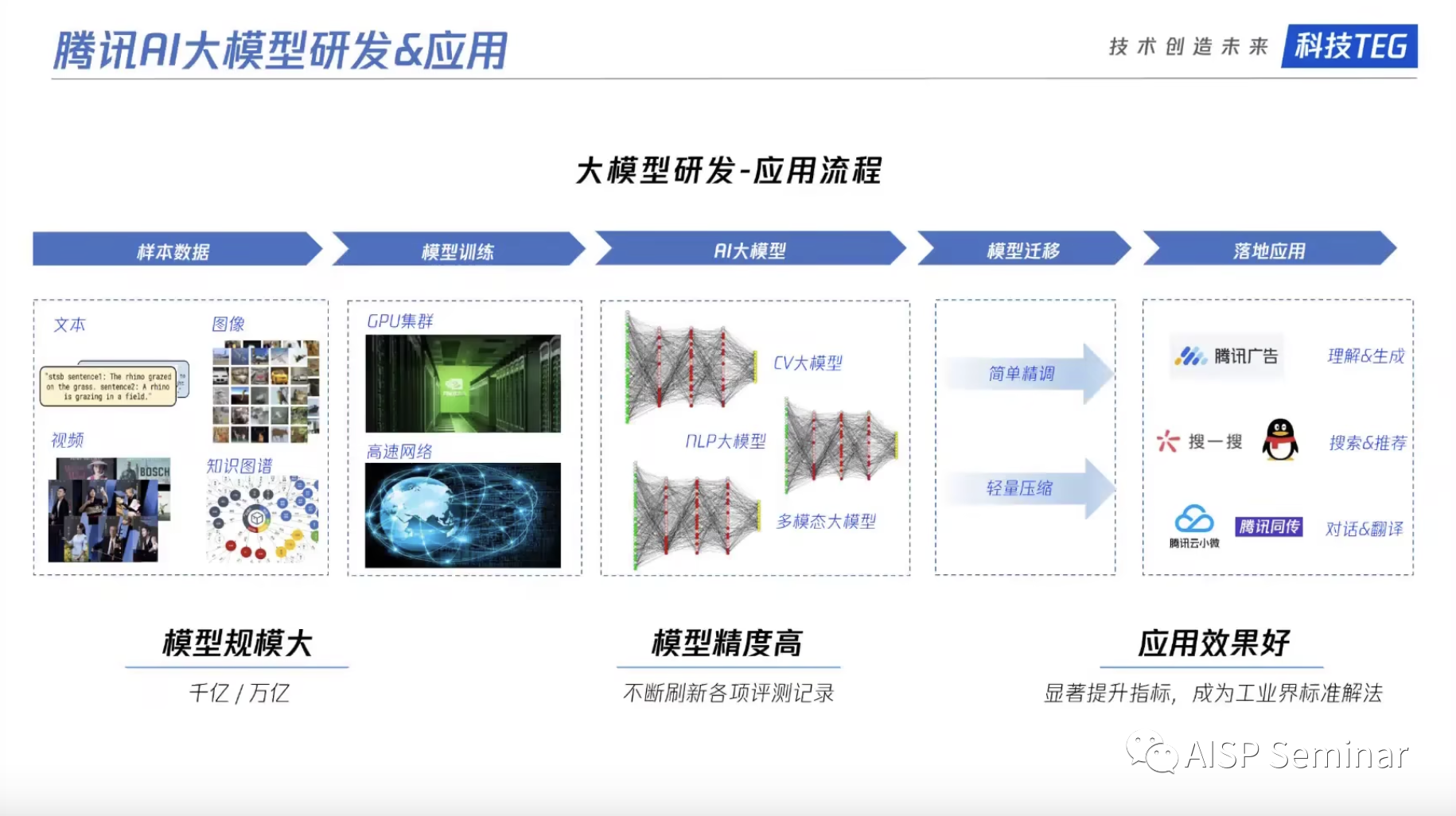

随着AI技术的快速发展,越来越多的AI项目需要使用个人数据进行训练和优化。然而,如果个人数据处理不当,可能会导致隐私泄露、歧视等问题。因此,在AI项目中,必须高度重视个人隐私数据的保护。

AI项目中保护个人隐私数据的策略

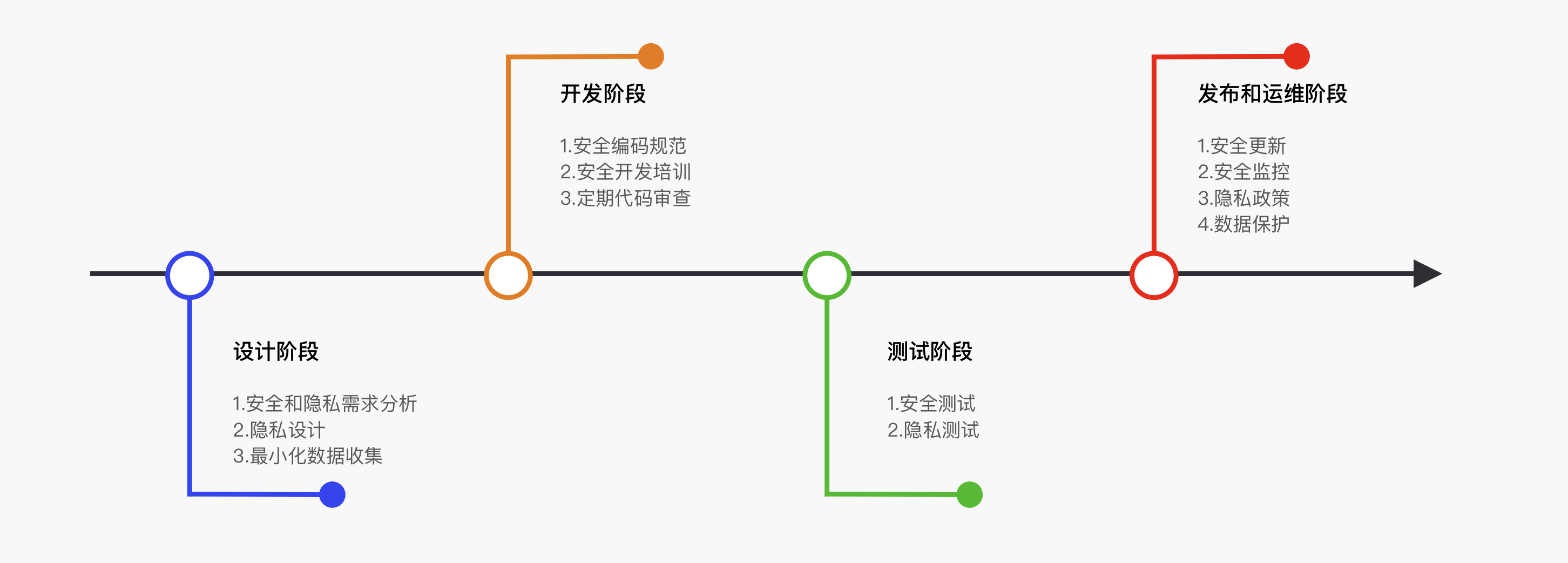

1. 数据最小化原则

只收集和使用AI项目真正需要的个人数据。避免收集不必要的数据,并定期审查已收集的数据,删除不再需要的数据。例如,在一个面部识别AI项目中,可能只需要面部图像,而不需要用户的姓名、年龄等个人信息。如果实在需要,确保所有的数据采集活动都遵循相关的法律法规,例如《通用数据保护条例》(GDPR)和《加州消费者隐私法案》(CCPA)。

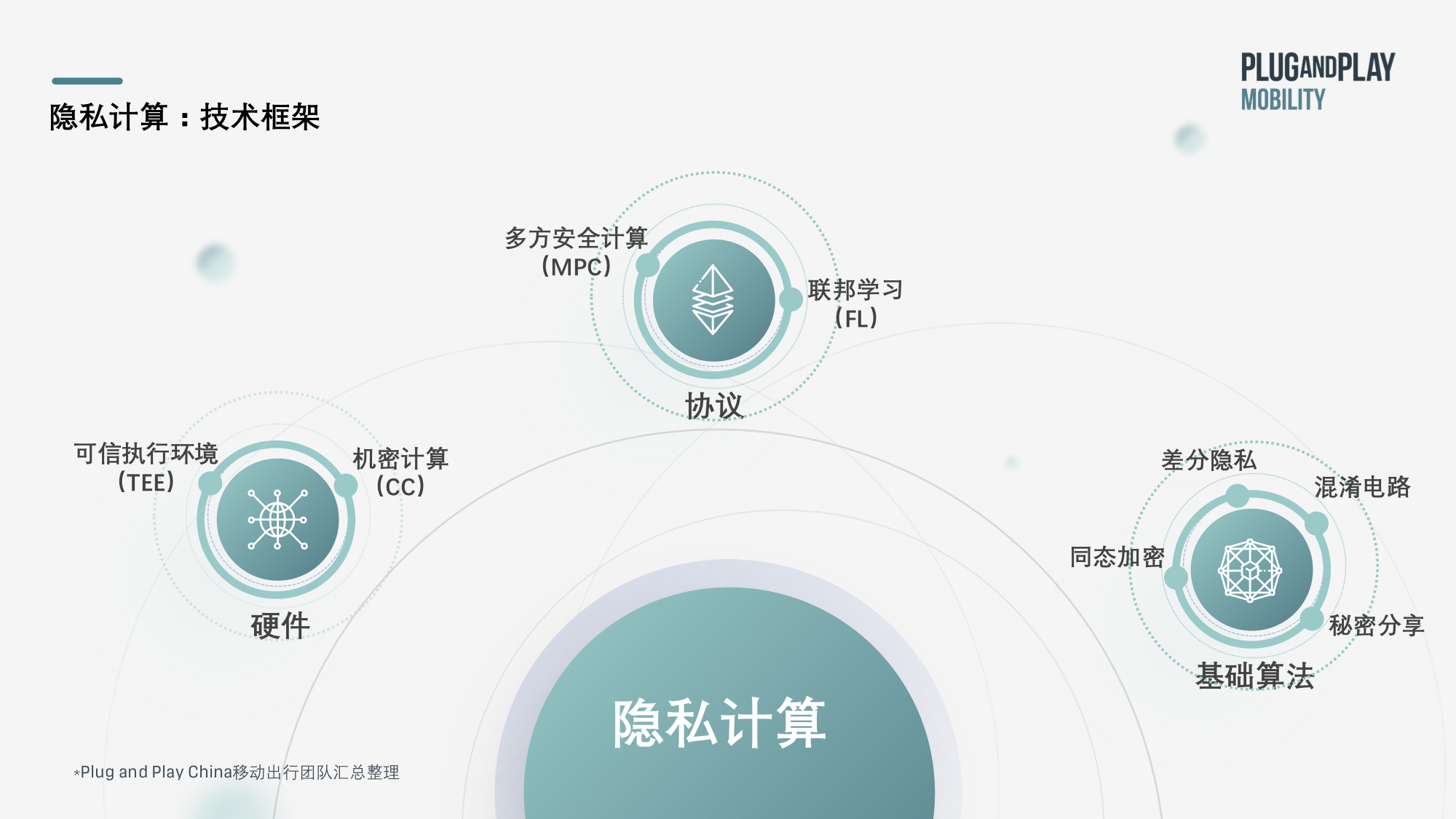

2. 差分隐私(Differential Privacy)

差分隐私是一种通过向数据集中添加噪声来保护个人隐私的技术。通过添加适当的噪声,可以在不泄露个体信息的情况下,获得关于数据集的有用统计信息。这在模型训练中使用敏感数据时尤其有用。例如,Google的RAPPOR系统就使用了差分隐私技术来收集用户数据。

差分隐私的优势在于其理论上的隐私保证,即使攻击者拥有关于数据集的大量背景知识,也无法确定特定个体是否参与了数据集。但是,差分隐私也会降低数据的准确性,需要在隐私保护和数据效用之间进行权衡。

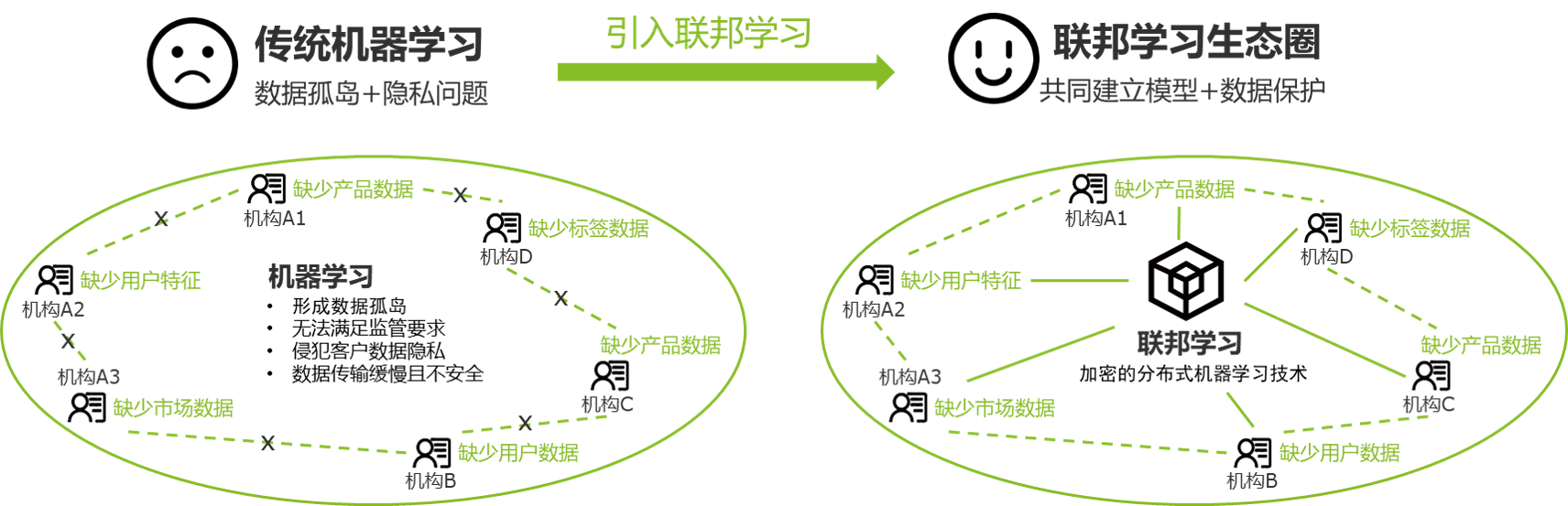

3. 联邦学习(Federated Learning)

联邦学习是一种分布式机器学习方法,允许在不共享原始数据的情况下训练模型。每个设备或组织在本地数据上训练模型,并将训练结果(例如模型参数)发送到中央服务器进行聚合。中央服务器将聚合后的模型参数发送回每个设备或组织,用于下一轮训练。通过这种方式,可以在保护个人隐私的同时,训练出高质量的AI模型。例如,Google的Gboard键盘就使用了联邦学习技术来改进输入法模型。

联邦学习的优势在于避免了将敏感数据集中存储,降低了数据泄露的风险。但是,联邦学习也存在一些挑战,例如通信成本高、异构数据处理难等。

4. 同态加密(Homomorphic Encryption)

同态加密是一种允许在加密数据上进行计算的技术。这意味着可以在不解密数据的情况下,对加密数据进行处理,并将结果返回给数据所有者。同态加密可以用于在保护个人隐私的同时,进行AI模型训练和推理。例如,可以利用同态加密技术,在加密的用户数据上训练AI模型,并将训练后的模型用于预测。

同态加密的优势在于其强大的隐私保护能力,可以在任何情况下保护数据的安全。但是,同态加密的计算成本非常高,限制了其在实际应用中的使用。

5. 安全多方计算(Secure Multi-Party Computation, MPC)

安全多方计算允许多方在不泄露各自私有数据的情况下,共同计算一个函数。在AI项目中,可以使用安全多方计算来实现安全的模型训练和推理。例如,可以使用安全多方计算,让多个机构在不共享各自客户数据的情况下,共同训练一个信用风险评估模型。

安全多方计算的优势在于其强大的隐私保护能力和灵活性,可以实现各种复杂的计算任务。但是,安全多方计算的计算成本也比较高,需要仔细设计计算协议,才能保证其性能。

6. 匿名化和假名化

匿名化是指将个人数据处理成无法识别特定个人的形式。假名化是指使用化名代替真实姓名,但仍然可以将数据与特定个人关联起来。在AI项目中,可以使用匿名化和假名化技术来降低隐私风险。例如,可以将用户的姓名替换成唯一的ID,并将用户的地址信息进行模糊处理。

需要注意的是,匿名化和假名化并不总是能够完全保护个人隐私。例如,如果攻击者拥有关于数据集的其他信息,仍然有可能通过关联分析来识别特定个人。因此,在采用匿名化和假名化技术时,需要仔细评估其隐私保护效果。

7. 访问控制和数据脱敏

实施严格的访问控制策略,只允许授权人员访问敏感数据。对敏感数据进行脱敏处理,例如屏蔽敏感字段、替换敏感值等。例如,可以将用户的信用卡号进行屏蔽,只显示后四位。

访问控制和数据脱敏是保护个人隐私数据的基础措施,可以有效地防止未经授权的访问和泄露。

8. 透明度和用户控制

告知用户AI项目如何收集、使用和存储其个人数据。给予用户控制其个人数据的权利,例如允许用户查看、修改或删除其个人数据。例如,可以提供一个用户界面,让用户可以管理其个人数据,并设置其隐私偏好。

透明度和用户控制是建立用户信任的关键,可以有效地提高用户对AI项目的接受度。

9. 合规性与审计

确保AI项目符合相关的法律法规和行业标准,例如GDPR和CCPA。定期进行隐私审计,评估AI项目的隐私风险,并采取相应的措施。例如,可以聘请专业的隐私顾问,对AI项目进行全面的隐私评估。

合规性与审计是保证AI项目长期健康发展的关键,可以有效地降低隐私风险和法律风险。

案例分析:AI项目中保护个人隐私数据的成功实践

以下是一些AI项目中保护个人隐私数据的成功案例:

| 案例 | 描述 | 隐私保护策略 |

|---|---|---|

| Google的联邦学习 | Gboard键盘使用联邦学习改进输入法模型 | 联邦学习 |

| Apple的差分隐私 | Apple使用差分隐私收集用户使用情况数据 | 差分隐私 |

| OpenMined的PySyft | PySyft是一个用于安全和私有的AI的Python库 | 联邦学习、差分隐私、同态加密 |

资料来源:各公司官网及相关技术文档

结论

如何在AI项目中保护个人隐私数据是一个复杂但至关重要的问题。通过采用数据最小化原则、差分隐私、联邦学习、同态加密、安全多方计算、匿名化和假名化、访问控制和数据脱敏、透明度和用户控制以及合规性与审计等策略,可以在保护个人隐私的同时,构建高质量的AI系统。在数据驱动的时代,保护用户隐私是赢得用户信任,实现可持续发展的关键。更多关于隐私保护、数据安全相关的技术和解决方案,请参考XXX(这里填写主体网站首页地址,如果网站名称为空就不加超链接)。

相关推荐

- AI 全渠道客服落地实战:独立解决 90% 咨询,获客率提升 40%

- AI 内容优化实战:自然流量增长 180% 的落地方案

- AI 插画设计落地实战:营销素材产出提速 10 倍的电商方案

- AI 面试评估落地实战:筛选效率提升 3 倍与误筛率降 65% 方案

- AI 客服机器人落地实战:成本降 45% 且转化升 40% 的全场景方案

- AI 客户分群实战方案:精准营销转化率提升 28% 的落地路径

- AI 广告投放落地实战:获客成本降 45% 与 ROI 翻倍的完整方案

- AI 背景调查落地实战:招聘周期缩短 70% 的企业级应用方案

- AI 邮件营销落地实战:打开率提升 15% 与转化翻倍的完整方案

- AI看板管理落地实战:销售响应提速 60% 的业绩增长方案