什么是学习率?2026 版全面解析:从优化原理到智能教育实战

一句话定义

学习率(Learning Rate)是深度学习优化算法中的核心超参数,它决定了模型在每次迭代中根据误差梯度调整权重的步长大小。

技术原理:掌控模型进化的“步伐”

在人工智能的宏大叙事中,神经网络的训练过程往往被描绘成一种神秘的“自我进化”。然而,剥开这层神秘的面纱,其底层逻辑其实是一个严谨的数学优化过程。而在这个过程当中,**学习率是什么**?它是决定这场进化是走向成功还是陷入停滞的关键变量。要深入理解 2026 年视角下的学习率,我们需要从优化原理、工作机制以及它与传统方法的本质区别三个维度进行剖析。

### 核心工作机制:梯度下降与步长的博弈

想象你是一位登山者,身处云雾缭绕的高山之巅(代表高损失函数值),你的目标是找到山谷的最低点(代表全局最优解,即损失函数最小化)。由于雾气太重,你无法一眼看到谷底,只能感知脚下最陡峭的下坡方向。这个“最陡峭的下坡方向”,在数学上被称为**梯度(Gradient)**。

每一次你根据梯度的方向迈出一脚,就是一次**参数更新(Parameter Update)**。而你这一脚跨出去有多大,完全由**学习率($\eta$ 或 $lr$)**决定。

用经典的随机梯度下降(SGD)公式来表达,权重更新的过程如下:

$$ \theta_{t+1} = \theta_t - \eta \cdot \nabla J(\theta_t) $$

其中:

* $\theta$ 代表模型的参数(权重和偏置)。

* $\nabla J(\theta_t)$ 是当前时刻的损失函数梯度,指示了下降的方向。

* $\eta$ 就是学习率,它是一个标量系数,控制着更新的幅度。

如果学习率过大,就像登山者步子迈得太大,可能会直接跨过谷底,冲到对面的山坡上,甚至越跳越高,导致**发散(Divergence)**,模型永远无法收敛。反之,如果学习率过小,登山者只能像蚂蚁一样挪动,虽然最终可能到达谷底,但需要耗费极长的时间,计算成本高昂,且极易陷入局部的**鞍点(Saddle Point)**或微小的凹陷中无法自拔,导致**收敛过慢**。

因此,学习率的本质是在“收敛速度”与“收敛稳定性”之间寻找最佳平衡点。在 2026 年的主流架构中,这一机制已经不再是静态的设定,而是演变为动态的、自适应的策略。

### 关键技术组件:从静态到动态的演进

在早期的深度学习实践中(如 2012-2015 年),工程师们通常手动设定一个固定的学习率,例如 0.01 或 0.001。这种方法简单粗暴,但在面对复杂的非凸优化曲面时显得力不从心。随着技术的发展,围绕学习率衍生出了一系列关键的技术组件和策略:

1. **学习率调度器(Learning Rate Scheduler)**:

这是最基础的动态调整策略。它的核心思想是“先快后慢”。在训练初期,使用较大的学习率让模型快速穿越平坦区域,接近最优解;随着训练的进行,逐渐减小学习率,以便在谷底附近进行精细的微调。常见的调度策略包括:

* **阶梯式衰减(Step Decay)**:每隔固定的轮数(Epoch),将学习率除以一个系数(如 0.1)。

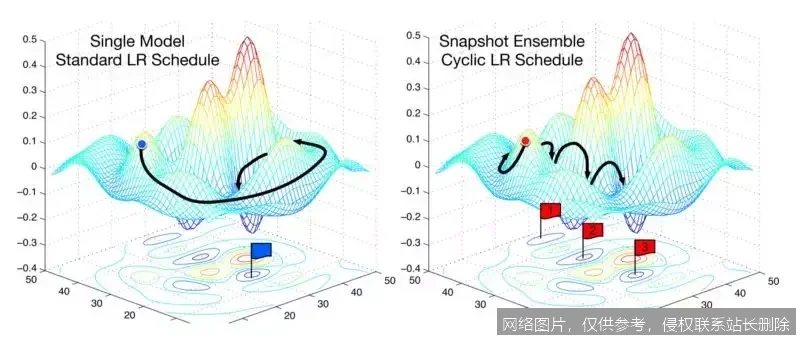

* **余弦退火(Cosine Annealing)**:模拟余弦函数的曲线,让学习率平滑地从最大值下降到最小值,甚至周期性重启(Warm Restarts),帮助模型跳出局部最优。

* **线性预热(Linear Warmup)**:在训练刚开始的几个步骤中,让学习率从 0 线性增加到预设值。这在 Transformer 等大模型训练中至关重要,能防止初期梯度爆炸导致的模型崩溃。

2. **自适应优化器(Adaptive Optimizers)**:

到了 2026 年,纯粹的 SGD 已较少单独使用,取而代之的是集成了自适应学习率机制的优化器,如 **Adam (Adaptive Moment Estimation)**、**AdamW** 以及更新的 **Lion** 等。

这些优化器的革命性在于,它们不再为所有参数使用同一个全局学习率,而是为每一个参数维护一个独立的、动态变化的学习率。它们通过记录梯度的历史一阶矩(均值)和二阶矩(未中心化的方差),自动调整每个维度的更新步长。对于频繁更新的参数,自动减小步长;对于稀疏更新的参数,自动增大步长。这使得“学习率是什么”这个问题的答案变得更加丰富:它不再仅仅是一个标量,而是一个随时间和参数维度变化的矩阵。

### 与传统方法的对比:启发式搜索 vs. 数学优化

为了更清晰地定位学习率在 AI 领域的独特性,我们可以将其与传统软件工程或经典算法中的参数调整方法进行对比。

在传统编程中,逻辑是确定性的。如果你写了一个 `if-else` 语句,条件的阈值通常是开发者根据业务规则硬编码(Hard-coded)的,或者是通过简单的二分查找等启发式方法确定的。这种调整是基于规则的,不具备“自我修正”的能力。

而在深度学习中,学习率所驱动的优化过程是基于数据的统计特性。

* **传统方法**:依赖人工经验设定固定阈值,环境变化时需人工重新调整。

* **基于学习率的方法**:模型通过反向传播算法,利用数据分布的梯度信息,自动寻找损失函数的极小值。学习率作为控制这一自动过程的“阀门”,使得模型具备了从数据中“学习”规律的能力,而非仅仅执行预设指令。

此外,传统的数值优化方法(如牛顿法)虽然理论上收敛更快,但需要计算海森矩阵(Hessian Matrix),其计算复杂度随参数量呈平方级增长,对于拥有千亿参数的现代大语言模型(LLM)来说是完全不可行的。基于一阶梯度(梯度下降)并配合精妙学习率策略的方法,成为了处理高维、大规模数据的唯一可行路径。

总结来说,学习率不仅是优化算法中的一个系数,它是连接数据误差与模型智能的桥梁。没有合适的学习率策略,再强大的神经网络架构也只是一堆随机初始化的数字,无法涌现出任何智能。

核心概念:构建知识图谱

要真正掌握“学习率是什么”,必须理清它与周围一系列关键概念的共生关系。这些概念共同构成了深度学习优化的生态系统。

### 关键术语解释

1. **梯度(Gradient)**:

梯度是多元函数在某一点的变化率向量,指向函数值增长最快的方向。在神经网络训练中,我们沿着梯度的反方向更新参数。如果把损失函数比作地形,梯度就是坡度的测量仪。学习率则是决定你顺着坡度走多快的控制器。

2. **损失函数(Loss Function)**:

也称为目标函数,用于量化模型预测值与真实值之间的差异。优化的目标就是最小化这个函数。学习率的大小直接影响模型逼近损失函数最小值的路径形态。

3. **超参数(Hyperparameter)**:

学习率属于超参数,这意味着它不是模型通过训练数据学习出来的(像权重那样),而是在训练开始前由人类工程师设定的,或者由元学习算法生成的。它是控制学习过程的“元指令”。

4. **局部最优(Local Optima)与全局最优(Global Optima)**:

在非凸的损失函数曲面上,存在许多低谷。局部最优是指在一个小范围内最低的点,但不是整个曲面的最低点。过小的学习率容易导致模型被困在局部最优;而适当的大学习率或动量(Momentum)可以帮助模型“跃出”浅层的局部坑洼,寻找更深的全局最优解。

5. **动量(Momentum)**:

这是一个常与学习率配合使用的概念。它模拟物理学中的惯性,让参数更新不仅考虑当前的梯度,还保留一部分上一次更新的方向。动量可以加速收敛并抑制振荡,实际上它改变了有效学习率的动态表现。

### 概念关系图谱

我们可以将上述概念构建成一个逻辑闭环:

* **输入**:数据批次(Batch)进入模型。

* **前向传播**:产生预测结果,结合标签计算**损失函数**值。

* **反向传播**:计算**梯度**,指示参数调整方向。

* **优化器核心**:读取当前**学习率**(可能是静态的,也可能是由**调度器**根据当前 Epoch 动态计算的,或者是**自适应优化器**内部计算的逐参数学习率)。

* **更新动作**:结合**动量**等状态,利用公式 $NewWeight = OldWeight - LearningRate \times Gradient$ 完成更新。

* **循环**:重复此过程直至收敛。

在这个链条中,学习率处于承上启下的枢纽位置:它接收梯度的方向信息,并将其转化为实际的参数位移量。

### 常见误解澄清

关于学习率,业界存在一些长期存在的误解,特别是在 2026 年大模型普及的背景下,更需要正本清源。

**误解一:“学习率越大,训练越快。”**

* **真相**:这是一个危险的陷阱。虽然在一定范围内增大会加快收敛,但一旦超过临界值(Critical Learning Rate),模型不仅不会变快,反而会剧烈震荡甚至发散,导致损失函数值变成 NaN(Not a Number)。这就好比开车,油门踩到底不一定最快到达终点,很可能直接冲出跑道。

**误解二:“找到一个完美的学习率后就可以一劳永逸。”**

* **真相**:在深度学习中,不存在贯穿始终的“完美学习率”。训练的不同阶段需要不同的步长。早期需要大步跨越,后期需要小步微调。现代最佳实践几乎都采用动态调整策略(如 Warmup + Decay),固定学习率仅在极简单的任务中有效。

**误解三:“自适应优化器(如 Adam)不需要关心学习率。”**

* **真相**:虽然 Adam 等优化器自动化了部分调整工作,但初始学习率(Base Learning Rate)依然是一个极其敏感的超参数。设置不当(例如默认值 0.001 对某些任务太大或太小)依然会导致训练失败。自适应机制解决的是“不同参数不同步长”的问题,并没有完全消除对全局基准学习率设定的依赖。

**误解四:“学习率只影响收敛速度,不影响最终精度。”**

* **真相**:大量研究表明,学习率轨迹直接影响模型泛化能力(Generalization)。较大的学习率有时能帮助模型逃离尖锐的极小值(Sharp Minima),落入平坦的极小值(Flat Minima),后者通常对应着更好的泛化性能。因此,学习率的选择直接关系到模型上线后的实际表现。

实际应用:从实验室到产业界的落地

理解了原理和概念后,我们来看看“学习率是什么”在实际工程中是如何发挥作用的。在 2026 年的 AI 应用版图中,学习率的调控技术已经渗透到了从底层芯片训练到上层教育应用的每一个角落。

### 典型应用场景

1. **大语言模型(LLM)的预训练**:

这是目前对学习率策略要求最高的场景。训练一个千亿参数级别的模型,耗时数月,消耗数百万美元算力。如果学习率曲线设计不当,可能导致前功尽弃。

* **实战策略**:目前行业标准普遍采用"Linear Warmup + Cosine Decay"组合。即在最初的 1%-5% 的训练步数中,学习率从 0 线性上升至峰值(如 $2 \times 10^{-4}$),随后按照余弦曲线缓慢下降至峰值的 10% 左右。这种策略保证了训练初期的稳定性和后期的精细收敛。

* **案例**:在训练类似 Llama 系列或 GPT 系列的模型时,工程师会通过小规模实验(Scaling Laws)预测最佳峰值学习率,并严格监控验证集损失,一旦发现异常震荡立即触发熔断机制调整学习率。

2. **计算机视觉中的迁移学习(Transfer Learning)**:

当我们将一个在 ImageNet 上预训练好的模型(如 ResNet, ViT)应用到具体的医疗影像诊断或工业缺陷检测时,学习率的设定大有讲究。

* **差异化学习率(Discriminative Learning Rates)**:这是一种高级技巧。对于模型中靠近输入的底层卷积层(负责提取边缘、纹理等通用特征),我们给予非常小的学习率(甚至冻结不更新),以保留预训练的通用知识;而对于靠近输出的高层全连接层(负责特定分类任务),则给予较大的学习率,使其快速适应新任务。这种“分层设率”的策略极大地提升了小样本场景下的模型性能。

3. **强化学习(Reinforcement Learning)中的策略优化**:

在 AlphaGo 或机器人控制领域,代理(Agent)通过与环境交互来学习。这里的策略网络更新同样依赖学习率。由于强化学习的样本相关性高、方差大,学习率通常需要设置得非常小,并配合复杂的裁剪机制(如 PPO 算法中的 Clip 操作),防止单次更新破坏已有的策略,导致智能体“遗忘”之前的技能。

### 代表性产品与项目案例

* **Hugging Face Transformers 库**:

作为全球最流行的 NLP 开源库,它内置了丰富的 `get_scheduler` 函数。开发者只需一行代码即可调用 `linear`, `cosine`, `polynomial` 等多种学习率调度策略。这极大地降低了“学习率调优”的门槛,让普通开发者也能享受到顶尖实验室的优化红利。

* **PyTorch Lightning / Keras**:

这些高层框架将学习率监控可视化。在训练过程中,它们可以实时绘制“学习率 vs 损失值”的曲线图,帮助工程师直观地判断当前设置是否合理。

* **AutoML 工具(如 Google Vertex AI, Azure ML)**:

在 2026 年,大多数企业用户不再手动调节学习率。AutoML 平台利用贝叶斯优化(Bayesian Optimization)或基于群体的训练(Population Based Training, PBT),自动在后台并行尝试数百种学习率组合,自动筛选出最优配置。这对于缺乏算法专家的传统企业来说,是实现 AI 落地的关键。

### 使用门槛和条件

尽管工具和框架日益完善,但要精通学习率的运用,仍具备一定的门槛:

1. **算力成本**:

寻找最佳学习率往往需要进行多次试错实验(Grid Search 或 Random Search)。在大规模模型上,每一次试错都意味着巨大的显存消耗和时间成本。因此,高效的学习率探索策略(如学习率范围测试,LR Range Test)是必备技能。

2. **领域知识**:

不同的任务类型(生成式 vs 判别式)、不同的数据类型(文本 vs 图像 vs 表格)对学習率的敏感度截然不同。工程师需要积累大量的“手感”和经验,才能在没有自动化辅助的情况下做出正确判断。

3. **调试能力**:

当模型不收敛时,能够迅速判断是学习率过大导致发散,还是过小导致陷入局部最优,亦或是数据本身的问题,这需要深厚的理论功底和敏锐的直觉。

延伸阅读:通往高阶之路

如果您对“学习率是什么”有了初步的理解,并希望在这一领域继续深耕,以下路径和资源将助您从入门走向精通。

### 相关概念推荐

为了构建完整的知识体系,建议您进一步研究以下关联概念:

* **批量大小(Batch Size)**:它与学习率存在强烈的耦合关系。通常批大小增大,学习率也应相应增大(线性缩放规则或平方根缩放规则)。

* **正则化技术(Regularization)**:如 Dropout、Weight Decay(权重衰减)。注意,在 AdamW 优化器中,权重衰减与学习率是解耦的,这与传统 L2 正则化不同,是近年来的重要理论突破。

* **二阶优化方法(Second-order Optimization)**:了解 Shampoo、K-FAC 等试图近似海森矩阵的优化器,理解它们在何种场景下能比一阶方法更高效。

* **神经正切核(Neural Tangent Kernel, NTK)**:从理论角度理解无限宽神经网络在梯度下降下的行为,深入探究学习率在理论极限下的作用。

### 进阶学习路径

1. **基础阶段**:

* 掌握微积分基础(链式法则、偏导数)。

* 阅读吴恩达(Andrew Ng)的《Deep Learning Specialization》课程中关于优化算法的章节。

* 动手实践:使用 PyTorch 或 TensorFlow 从零实现一个带有不同学习率调度器的 SGD 优化器。

2. **进阶阶段**:

* 研读经典论文:《Adam: A Method for Stochastic Optimization》(Kingma & Ba, 2014)、《Decoupled Weight Decay Regularization》(Loshchilov & Hutter, 2017)。

* 学习大规模分布式训练中的学习率同步策略(如 Ring AllReduce 对学习率的影响)。

* 参与 Kaggle 竞赛,观察顶尖选手如何通过精细调整学习率曲线来提升 0.001 的分数。

3. **专家阶段**:

* 关注顶级会议(ICLR, NeurIPS, ICML)中关于优化理论的最新进展。

* 研究大模型训练中的“灾难性遗忘”与学习率的关系。

* 尝试复现或改进现有的自适应优化算法,针对特定硬件架构(如 TPU、NPU)进行算子级的优化。

### 推荐资源和文献

* **经典教材**:

* 《Deep Learning》by Ian Goodfellow, Yoshua Bengio, and Aaron Courville. (被誉为深度学习圣经,第 8 章详细讲解了优化算法)。

* 《Hands-On Machine Learning with Scikit-Learn, Keras, and TensorFlow》by Aurélien Géron. (实操性强,包含大量关于学习率调优的代码示例)。

* **在线资源**:

* **Papers With Code**:搜索 "Learning Rate Schedule" 或 "Optimizer",查看带有代码实现的最新论文。

* **Distill.pub**:该网站提供极具可视化的文章,如《Why Momentum Really Works》,能直观展示学习率和动量的动态效果。

* **Hugging Face Course**:免费且高质量的实战课程,专门有一节讲解 Trainer API 中的学习率配置。

* **关键论文清单**:

1. *Smith, L. N. (2017). Cyclical Learning Rates for Training Neural Networks.* (提出了循环学习率,颠覆了单调递减的传统认知)。

2. *Goyal, P., et al. (2017). Accurate, Large Minibatch SGD: Training ImageNet in 1 Hour.* (确立了学习率与 Batch Size 的线性缩放规则)。

3. *Loshchilov, I., & Hutter, F. (2019). Decoupled Weight Decay Regularization.* (引入了 AdamW,解决了 Adam 中权重衰减与学习率耦合的问题)。

在 2026 年及未来的 AI 浪潮中,虽然自动化工具会越来越强大,但深刻理解“学习率是什么”及其背后的优化哲学,依然是区分普通调用者与顶尖 AI 工程师的分水岭。它不仅是一个参数,更是人类智慧引导机器智能不断逼近真理的罗盘。

相关推荐

- Tokenizer 是什么:大模型文本处理基石的原理、演进与 2026 应用全解析

- 什么是 DeepL?2026 年语言 AI 原理、应用与实战全面解析

- TPU 是什么?2026 最新定义、核心原理与实战应用全面解析

- 数据并行是什么:2026 大模型训练核心原理、架构演进与实战详解

- SDK 是什么?2026 最新定义、核心原理与全场景应用详解

- Stable Diffusion 详解:2026 技术原理、架构演进与行业应用全解析

- Max Tokens 是什么:2026 大模型输出控制原理与实战详解

- 什么是 PEFT 参数高效微调?2026 原理、技术与实战全面解析

- Fine-tuning 是什么:2026 年微调技术原理、行业应用与实战详解

- 红队是什么:从军事模拟到攻防演练的原理、应用与实战全解析